Queremos agentes.

Pero no hemos resuelto la alfabetización digital seria.

Queremos automatización.

Pero no hemos enseñado a distinguir entre dato visible y dato confiable.

Queremos respuestas rápidas.

Pero no hemos formado personas capaces de exigir evidencia, trazabilidad, seguridad e integridad.

Ese vacío no nació con los agentes IA. Pero ellos lo exponen con brutal claridad.

Durante años, la educación se concentró en transmitir contenidos, en formar para la ejecución, en enseñar herramientas prácticas o en repetir conocimientos compartimentados. Mientras tanto, el mundo cambiaba de lenguaje. Se volvía digital, algorítmico, interconectado, automatizado. Y en ese cambio, lo que se necesitaba no era solo más información: se necesitaban nuevas capacidades de interpretación, de juicio, de lectura crítica del dato y de comprensión estructural del proceso.

Eso no ocurrió con la profundidad necesaria.

Por eso hoy convivimos con una paradoja inquietante: personas rodeadas de tecnología avanzada, pero con una comprensión todavía precaria del mundo que esa tecnología representa.

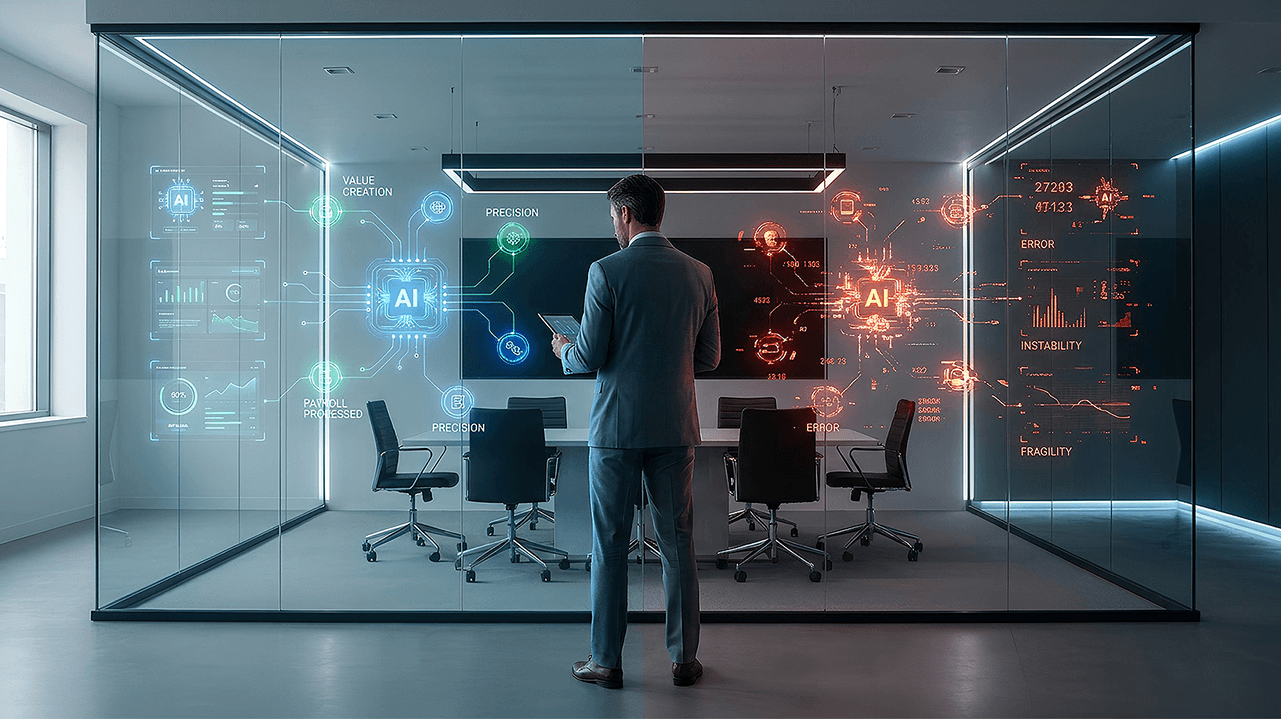

Y en ese contexto, los agentes IA pueden ser mal leídos.

Pueden parecer la solución, cuando en realidad están actuando como una señal de alarma.

Pueden parecer el siguiente paso, cuando en realidad están mostrando cuánto nos falta por aprender.

Pueden parecer la evidencia de nuestra madurez digital, cuando en realidad ponen en evidencia nuestra inmadurez.

Porque el problema no es solo qué tan inteligentes son los agentes.

El problema es qué tan preparados estamos nosotros para trabajar con ellos sin caer en la ilusión de control, sin delegar criterio ciegamente y sin construir decisiones sobre datos, procesos y estructuras que todavía no merecen plena confianza.

En Contabilidad y Remuneraciones, esto es aún más delicado. Allí no estamos hablando de curiosidad tecnológica, sino de procesos críticos que exigen rigor, evidencia, consistencia y responsabilidad. Allí un dato mal comprendido, un proceso mal trazado o una automatización operando sobre fragilidad no son simples errores de aprendizaje: pueden transformarse en decisiones equivocadas, riesgos operativos, pérdida de control y deterioro de la verdad económica o laboral.

Por eso, el debate de fondo no puede quedarse solo en la potencia de la herramienta. Debe volver a la formación de las personas.

Necesitamos una educación que enseñe a comprender el dato.

Que enseñe a pensar en evidencia.

Que enseñe a leer procesos y no solo pantallas.

Que enseñe a distinguir entre información, interpretación y verdad.

Que enseñe a convivir con algoritmos sin ingenuidad.

Que enseñe a administrar tecnología con criterio y no solo a consumirla con fascinación.

Ese es el desafío.

Porque mientras la industria T.I. aceleró la tecnología, la educación dejó demasiadas veces a las personas atrás. Y hoy los agentes IA están dejando en evidencia esa fractura.

No son la causa principal.

Son el síntoma incómodo.

El síntoma de que entramos al mundo digital sin haber sido preparados para habitarlo con responsabilidad.

El síntoma de que seguimos usando herramientas del futuro con categorías mentales del pasado.

El síntoma de que queremos inteligencia automatizada sin haber fortalecido primero la comprensión humana.

Por eso, si de verdad queremos una transformación seria, no basta con incorporar agentes IA. Hay que corregir el problema más oculto: una educación que todavía no ha entendido del todo qué tipo de ser humano, de profesional y de administrador exige esta nueva época.

Hasta que eso no ocurra, seguiremos viendo la misma escena: tecnologías cada vez más poderosas en manos de personas y organizaciones que aún no dominan plenamente el lenguaje del mundo al que están entrando.

Y ese es, probablemente, uno de los mayores riesgos de nuestro tiempo.